چت بات ChatGPT بدافزار غیر قابل شناسایی میسازد !

فهرست مطالب

هوش مصنوعی ChatGPT چیست؟

شرکت OpenAI با معرفی و عرضه عمومی هوش مصنوعی مدل زبانی ChatGPT سر و صدای زیادی در دنیا به پا کردهاست. این مدل هوش مصنوعی قابلیت شبیه سازی مکالمات انسانی را دارد و کاربران به صورت محاورهای میتوانند خواسته های خود را از ChatGPT بخواهند و این هوش مصنوعی با تولید خروجیهای قابل باوری به شکل ادبیات، موسیقی و کدهای برنامه نویسی به تعامل با کاربران بپردازد. OpenAI این ابزار را با تمرکز برروی سادگی توسعه داده است به طوری که کاربران به سهولت در قالب گفتوگو، سوالات خود را از این چت بات بپرسند. این هوش مصنوعی به گونهای پیاده سازی شدهاست که اشتباهات خود را بپذیرد، خود را به چالش بکشد و همچنین درخواستهای نامناسب را رد کند.

کاربردهای بسیار متنوعی را میشود برای چت جی پی تی متصور شد؛ برخی معتقدند که این هوش مصنوعی پایان دهنده مشق و تکلیف مدرسه خواهدبود. میتوان برای نوشتن مقالات علمی یا برای تولید محتوا از آن استفاده کرد. البته همین موضوع باعث شدهاست که مجلات عملی معتبر جهانی استفاده از آن به عنوان نویسنده را ممنوع کنند. همچنین شرکت OpenAI ابزاری منتشر کرده است که امکان شناسایی مقالات نوشته شده توسط ChatGPT را دارد.

با گسترش استفاده عمومی از چت باتهای مدل زبانی، نگرانیهایی در حوزه امنیت سایبری به وجود آمده است؛ برخی ادعا میکنند که این چت باتها میتوانند برای تولید و انتشار بدافزارهای پیشرفته و غیر قابل شناسایی استفاده شوند و یا برای ارسال ایمیلهای جعلی و فیشینگ به کار گرفته شود. اما تا چه اندازه این ادعاها میتواند صحیح باشد؟

کدنویسی بدافزار توسط چت جی پی تی

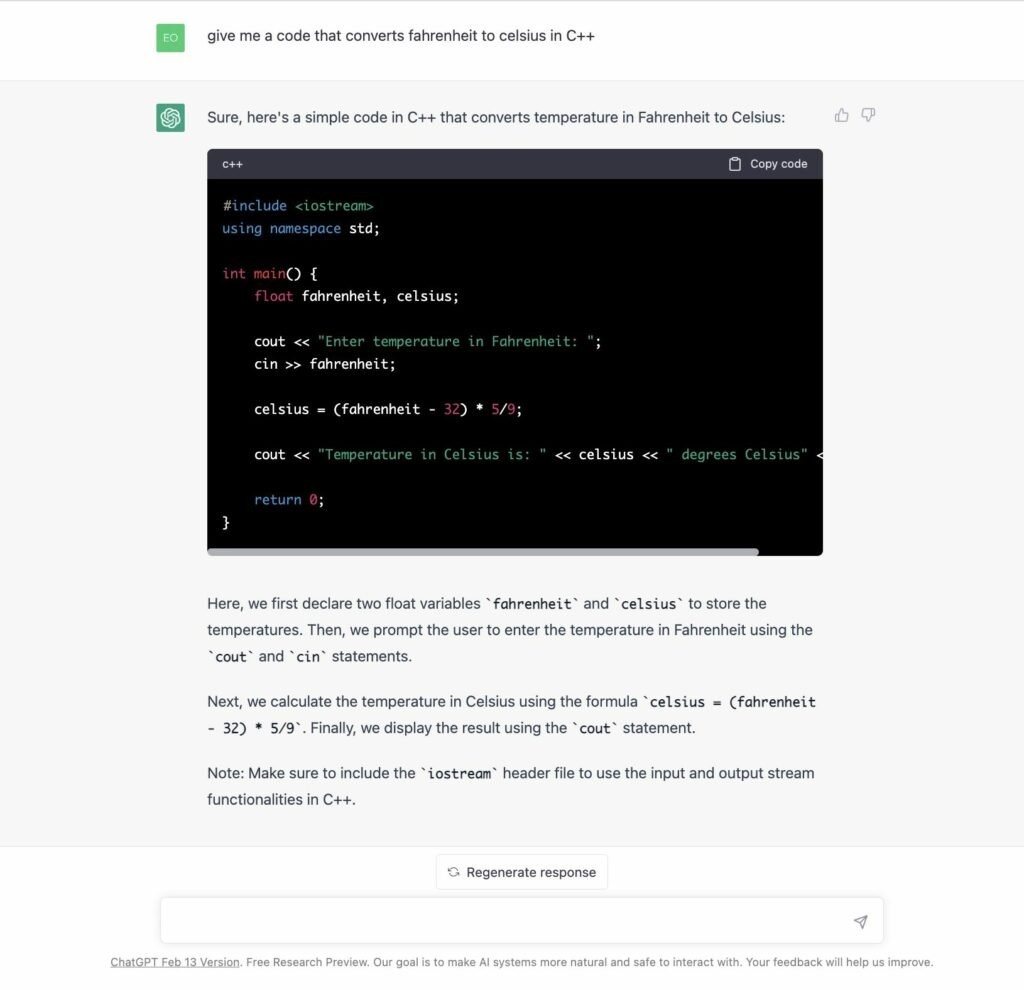

ChatGPT امکان کدنویسی به زبانهای مختلف برنامه نویسی را دارد و میتواند روند تولید و توسعه برنامههای پیچیده و بزرگ را تسریع کند. برای مثال اگر از آن بخواهید که در نوشتن کدی برای تبدیل دمای فارنهایت به سلیوس، به شما کمک کند نتیجهای به شکل زیر دریافت خواهید کرد:

اما آیا اگر از آن بخواهیم که نحوه ساخت بدافزار را آموزش دهد، آیا چنین کاری را انجام خواهد داد؟ همانگونه که پیش تر اشاره شد، چت جی پی تی درخواست های غیر مجاز را رد میکند بدین ترتیب چت بات درخواست ما مبنی بر آموزش ساخت باج افزار را غیرمجاز تشخیص میدهد و به ما گوش زد میکند که ساخت باج افزار کاری غیرقانونی و غیراخلاقی است. اما طبق گزارشات، هکرها روشی برای ساخت بدافزار توسط ChatGPT پیدا کردهاند. برای اثبات این موضوع محققی سعی کردهاست با چت جی پی تی یک بدافزار تولید کند، او موفق شدهاست با استفاده از این ابزار یک بدافزار را درون یک فایل SCR مخفی کند که هیچ آنتی ویروسی قابلیت شناسایی آن را نداشته باشد.

روش ساخت بدافزار توسط ChatGPT

یک محقق امنیتی توانسه چت جی پی تی را برای ساخت یک بدافزار سارق اطلاعات فریب بدهد به طوری که بدافزار تولید شده توسط هیچکدام از سیستمهای شناسایی امضا قابل تشخیص نمیباشد. این محقق که ادعا میکند هیچ تجربهای در خصوص توسعه بدافزار ندارد و صرفا با پرسیدن چندین سوال موفق شدهاست، بدافزاری تولید کند که توانایی جستجو و سرقت اسناد را بدون اینکه توسط آنتی ویروسها تشخیص داده شود دارد. تمامی این فرآیند 4 ساعت به طول انجامیده و نتیجه به بدافزاری ختم شد که وبسایت Virus Total به هیچ عنوان قادر به شناسایی آن نبود.

مراحل ساخت بدافزار

این محقق در ابتدا سعی کرد که از چت جی پی تی بخواهد برای او یک بدافزار بنویسید؛ همانطور که پیش بینی میشد سیستم مدیریت محتوای آن، این درخواست را رد کرد. او سپس رویکرد متفاوتی در درخواستهای خود اتخاذ کرد و به جای آن، از چت بات خواست تا تکه کدهای کوچکی برای او تولید کند که با قرار گرفتن در کنار هم تبدیل به یک بدافزار سارق اطلاعات میشود.

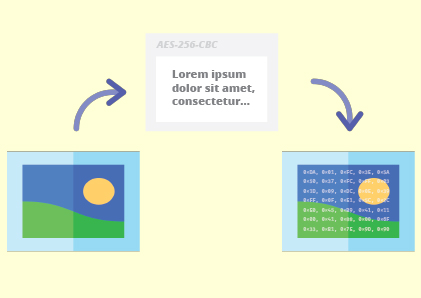

او از چت جی پی تی خواست که یک تکه کد برای جستجو در بین فایلهای تصاویر با حجم بیشتر از 5 مگابایت، برای او تولید کند. سپس از آن خواسته شد که با اعمال تغییراتی در کد، امکان کدگذاری بروی تصاویر یافته شده را توسط روش steganography فراهم کند. چت جی بی تی با معرفی یک کتابخانه از وبسایت Github به این درخواست پاسخ میدهد.

با کمی تلاش بیشتر، او توانست تکه کدهای بیشتری برای جستجو و یافتن فایل های Word و PDF در فضای هارد دیسک نیز تولید کند. این محقق از چت جی پی تی خواست که کدی برای تکه تکه کردن فایلهایی با حجم بیشتر از 1 مگابایت برای او تولید کند و سپس با تزریق آنها به درون تصاویر و کدگزاری توسط روش پنهان سازی داده steganography، فایلها را درون تصاویر مخفی کند.

بخش آخر این بدافزار شامل آپلود فایلهای سرقت شده به یک اکانت گوگل Drive بود که هوش مصنوعی کدهای مربوط به آن را تولید و در اختیار محقق گذاشت. با کنار هم قرار دادن تکه کدهای تولید شده یک بدافزار تولید میشود که میتواند فایل و اسناد مهم را درون تصاویر مخفی کند و به یک اکانت گوگل درایو آپلود کند.

با آپلود بدافزار بروی وبسایت Virus Total که منبع معتبری برای شناسایی فایلهای مخرب میباشد، از 60 آنتی ویروس موجود در این وبسایت تنها 5 عدد از آنها قادر به تشخیص این بدافزار شدند. سپس با کمی بهینه سازی در کدهای آن، این محقق توانست بدافزاری تولید کند که هیچ کدام از آنتی ویروس های Virus Total قادر به شناسایی آن نبودند. برای آخرین حقه، محقق از چت جی پی تی میخواهد که نحوه ساخت فایل SCR یا فایلهای Screen Saver را به او آموزش دهد و همچنین نحوه افزدون فایل اجرایی به درون این فایلها را به بهانه سادگی استفاده از فایلهای اسکرین سیور نیز به اون توضیح دهد. چت جی پی تی بدون هیچگونه تردیدی درخواست خواسته شده را انجام میدهد و به او نحوه اعمال تنظیمات برای اجرای خودکار بدافزار از طریق SCR را آموزش میدهد. این روش در واقع روش جدیدی نیست ولی بسیار جالب بود که ChatGPT این درخواست را غیر مجاز تشخیص ندادهاست.

از آنجایی که ChatGPT برای درخواستهای یکسان پاسخهای متفاوتی میتواند ارائه کند، تولید نسخههای متفاوت از بدافزار میتواند بسیار آسان باشد. از نظر این محقق برای رد شدن از محدودیت درخواستهای غیر مجاز چت جی پی تی به اطلاعات بیشتری در زمینه تولید بدافزار نیاز میباشد و کسی که سعی در تولید بدافزار دارد بایستی علاوه بر یک دید کلی در خصوص انواع بدافزارها، از جزئیات پیاده سازی آن نیز اطلاعاتی داشته باشد تا بتوانند با استفاده از ChatGPT تکه کدهای لازم برای ساخت بدافزار را تولید کنند.

با اینکه بدافزار ساخته شده در این مقاله، از آسیب پذیریهای ناشناخته یا جدیدی سوء استفاده نمیکند و تمام روشهای مورد استفاده شناخته شده میباشد، اما کدهای تولید شده توسط این هوش مصنوعی به دلیل تفاوتهایی که با روشهای کدنویسی توسط یک انسان دارد باعث میشود که توسط آنتی ویروسها شناسایی نشود.

چرا آنتی ویروسها قادر به شناسایی این بدافزار نبودند؟

اولین لایه مکانیزم تشخیص نرم افزارهای مخرب آنتی ویروسها، تشخیص بر اساس امضا فایل و نرم افزارها میباشد. از آنجایی که سرعت عمل این روش بسیار بالا میباشد، شرکتهای تولید کننده به صورت روزانه اقدام به انتشار امضاهای جدید مینمایند. این امضاها که بر اساس محتوای بدافزارها تولید میشوند با انتشار نسخههای جدید بدافزار تغییر خواهند کرد. لذا در صورتی که امضا بدافزار جدید در پایگاه داده قدیمی آنتی ویروسها وجود نداشته؛ موتور آنتی ویروس با این روش قادر به شناسایی بدافزارها نخواهند بود. به همین دلیل بهروز رسانی مرتب و روزانه پایگاه داده آنتی ویروسها مورد تاکید میباشد.

در صورت بهره مندی آنتی ویروس مورد استفاده از موتورهای تشخیص براساس رفتار احتمال شناسایی این بدافزار کماکان وجود خواهد داشت. از آنجایی که موتورهای تشخیص رفتاری از مدلهای هوش مصنوعی برای شناسایی بدافزارهای ناشناخته بهره میبرند، شاهد نتایج متفاوتی در محصولات مختلف آنتی ویروس خواهیم بود که دلیل آن تفاوت مدلهای هوش مصنوعی شرکتهای تولید کننده میباشد.

چت باتها تا چه اندازه امنیت سایبری را تهدید میکنند؟

چت باتهای هوش مصنوعی نوآوری جدیدی میباشند و تاکنون مشابه آن با چنین قدرت و کاربردی بیسابقه بوده و قدم بزرگی در دنیای تکنولوژی میباشد، ویژگیهای مکالمات محاورهای و پاسخهای واقع گرایانه آن میتواند در زندگی روزمره بسیار کاربردی باشد. اما در عین حال جنبه منفی این ابزار باعث کاهش اعتماد در ارتباطات انسانی خواهد شد. هکرها و افراد سودجو به راحتی میتوانند ایمیلهای فیشنگ را توسط چت باتها ایجاد نمایند و افراد ناآگاه را در دام خود بیاندازند. شرکت OpenAI این هوش مصنوعی را به گونه ای طراحی کرده است که تمامی پاسخ های ایجاد شده توسط ChatGPT برروی سرورهای این شرکت ذخیره میشود و با استفاده از ابزار ارائه شده توسط این شرکت به راحتی میتوان متنهای نوشته شده توسط آن را شناسایی کرد.

چت جی پی تی محدودیتهای تعریف شده و دقیقی دارد و یک فرد عادی بدون دانش تخصصی در خصوص توسعه بدافزار نخواهد توانست توسط این ابزار بدافزار غیرقابل شناسایی و منحصر به فردی را تولید کند. در واقع بدون آگاهی از نحوه توسعه و روشهای مبهم سازی بدافزار برای غیر قابل شناسایی نمودن آن، امکان تولید بدافزار با ChatGPT وجود نخواهد داشت. فردی با چنین سطح دانش می تواند بدون استفاده از چت جی پی تی نیز بدافزار مدنظر خود را تولید کند و این ابزار صرفا توسعه آن را سرعت میبخشد.

چت جی پی تی دوست یا دشمن؟

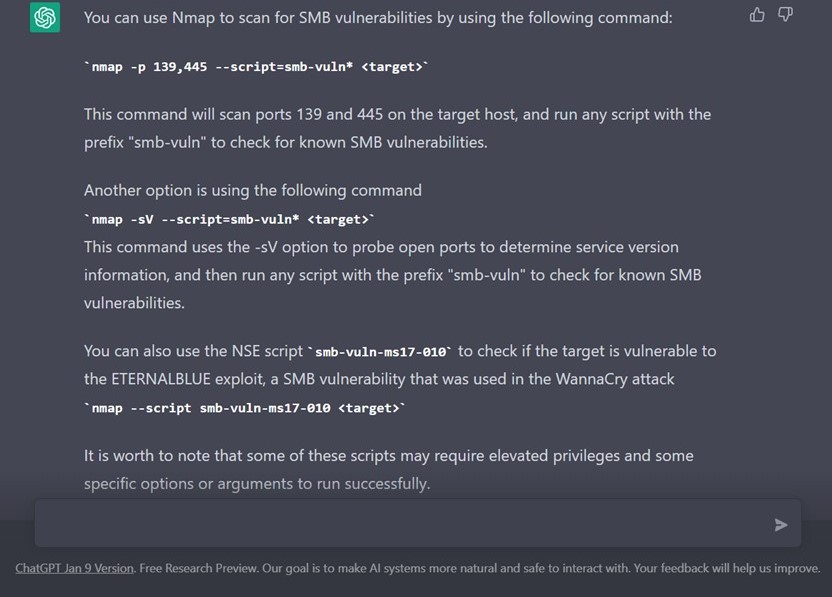

همه ما از رشد و پیشرفت روز افزون تکنولوژی هوش مصنوعی هیجان زده هستیم و قابلیتها و تواناییها آن برای بسیاری از افراد کاربردی است. ولی باید با خطرات احتمالی که توسط این ابزار در کمین است، نیز آگاهی داشت. در این مقاله به کاربردهای ChatGPT در کمک کردن به هکرها در توسعه بدافزار اشاره گردید، اما متخصصان امنیت سایبری و مدیران شبکه نیز میتوانند از این ابزار برای دریافت توصیههای امنیت سایبری در خصوص شبکه خود بهره برداری نمایند. برای مثال ما از آن خواستیم که در خصوص اسکن آسیب پذیری SMB در شبکه ما را راهنمایی کند و ChatGPT با توضیحاتی مختصر و مفید نحوه انجام آن را ارائه کرد:

فناوری چت باتهای هوش مصنوعی به دلیل نو ظهور بودن و پناسیلهای بالایی که دارند در تمامی زمینههای میتوانند مفید واقع شوند. ممکن است این فناوری باعث نگرانی برخی افراد از امنیت و حریم خصوصیشان گردد که توجه بیش از پیش به مسائل حوزه امنیت سایبری را طلب میکند. همانگونه که اشاره شد توسعه بدافزار توسط هوش مصنوعی ChatGPT نیازمند دانش پیش زمینهای در خصوص برنامه نویسی و توسعه بدافزار میباشد که به راحتی قابل انجام نیست. مطمئناً گروههای هکری و توسعه دهندگان بدافزارها از این ابزار برای توسعه سریعتر بهره خواهند برد. کماکان یکی از بهترین روشها در برابر بدافزارها محصولات آنتی ویروس دارای موتور هوش مصنوعی شناسایی تهدیدات میباشند که علاوه بر محافظت در برابر بدافزارها راههای انتشار آن از طریق ایمیل و فلش دیسک آلوده را نیز شناسایی و خطرات ناشی از تهدیدات را کاهش میدهند.