گوگل اعلام کرده است، هکرهای وابسته به دولتها از مدل هوش مصنوعی Gemini گوگل برای پشتیبانی از همه مراحل یک حمله، ازجمله شناسایی اولیه (Reconnaissance) تا اقدامات پس از نفوذ، استفاده میکنند.همچنین علاقه فراوانی به ابزارها و خدمات هوش مصنوعی نشان میدهند که میتواند در فعالیتهای غیرقانونی مانند کمپینهای مهندسی اجتماعی ClickFix به آنها کمک کند.

مجرمان سایبری از چین (APT31، Temp.HEX)، ایران (APT42)، کره شمالی (UNC2970) و روسیه برای پروفایلسازی اهداف و جمعآوری اطلاعات متنباز (OSINT)، تولید پیامهای فیشینگ، ترجمه متن، کدنویسی، آزمایش آسیبپذیریها و عیبیابی از Gemini استفاده کردهاند.

فعالیتهای مخرب انجام شده با هوش مصنوعی

گروه اطلاعات تهدید گوگل (GTIG) در گزارشی اعلام کرده است که مهاجمان APT از Gemini برای پشتیبانی از کمپینهای خود از مرحله شناسایی و ایجاد پیامهای فیشینگ گرفته تا توسعه زیرساخت فرماندهی و کنترل (C2) و استخراج دادهها استفاده میکنند.

یک عامل تهدید مستقر در چین (PRC) با ساختن یک سناریوی جعلی، در یکی از موارد ابزار Hexstrike MCP را آزمایش کرده و از مدل خواسته است آسیبپذیری اجرای کد از راه دور (RCE)، تکنیکهای دور زدن دیوار آتش برنامههای وب (WAF Bypass) و نتایج تست تزریق SQL را علیه اهداف مشخصی در ایالات متحده تحلیل کند.یکی دیگر از عوامل مستقر در چین بهطور مکرر از Gemini برای رفع اشکال کدهای خود، انجام تحقیقات و دریافت مشاوره درباره قابلیتهای فنی موردنیاز برای نفوذ استفاده کرده است.

عامل تهدید ایرانی APT42 نیز از مدل زبانی بزرگ (LLM) گوگل برای اجرای کمپینهای مهندسی اجتماعی بهره برده و از آن بهعنوان بستری برای تسریع در توسعه ابزارهای مخرب سفارشی (از جمله دیباگ، تولید کد و تحقیق درباره تکنیکهای بهرهبرداری) استفاده کرده است.همچنین سوءاستفادههای دیگری نیز که شامل افزودن قابلیتهای جدید به خانوادههای بدافزاری موجود، از جمله کیت فیشینگ CoinBait و بدافزار HonestCueمیشود،صورت گرفته است.

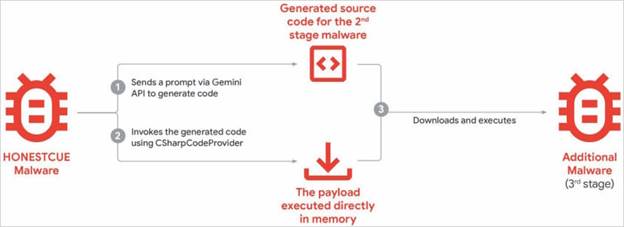

HonestCue یک چارچوب بدافزاری اثبات مفهوم (Proof-of-Concept) است که در اواخر سال ۲۰۲۵ مشاهده شد. این بدافزار از API Gemini برای تولید کد #C مربوط به مرحله دوم حمله استفاده میکند و سپس بارهای مخرب (Payload) را در حافظه کامپایل و اجرا میکند.

CoinBait یک کیت فیشینگ است که در قالب یک برنامه تکصفحهای (SPA) مبتنی بر React طراحی شده و خود را بهعنوان یک صرافی ارز دیجیتال جا میزند تا اطلاعات ورود کاربران را سرقت کند. این کیت حاوی شواهدی است که نشان میدهد توسعه آن با استفاده از ابزارهای تولید کد مبتنی بر هوش مصنوعی پیشرفتهتر شده است. یکی از نشانههای استفاده از مدلهای زبانی بزرگ (LLM)، وجود پیامهای ثبت لاگ در کد منبع بدافزار با پیشوند «,:Analytics» است که میتواند به مدافعان کمک کند فرآیندهای استخراج داده (Data Exfiltration) را ردیابی کنند.

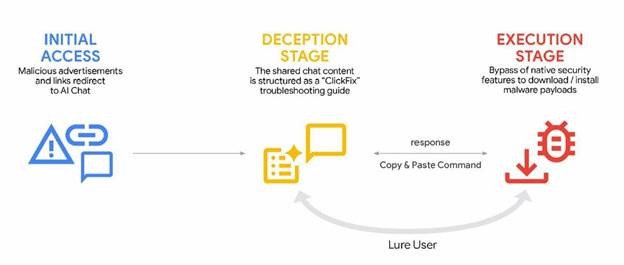

مجرمان سایبری همچنین از خدمات هوش مصنوعی مولد در کمپینهای ClickFix استفاده کردهاند و از این طریق بدافزار سرقت اطلاعات AMOS را برای سیستمعامل macOS توزیع کردهاند. کاربران از طریق تبلیغات مخرب که در نتایج جستجو و در پاسخ به پرسشهایی درباره رفع مشکلات خاص نمایش داده میشدند، فریب داده میشدند تا دستورات مخرب را اجرا کنند. پیشتر نیز گزارشهایی منتشر شده بود مبنی بر اینکه برخی مهاجمان با سوءاستفاده از ابزارهای هوش مصنوعی مانند ChatGPT اقدام به تولید بدافزارهایی با قدرت تشخیص پایین توسط سامانه های امنیتی کرده اند.

تلاش برای استخراج و تقطیر ،Gemini

Gemini با تلاشهایی برای استخراج و تقطیر (Distillation) مدل هوش مصنوعی مواجه شده است؛ بهطوریکه برخی سازمانها با استفاده از دسترسی مجاز به API، بهصورت سیستماتیک از این سامانه پرسشهایی مطرح کردهاند تا فرآیند تصمیمگیری آن را بازتولید کرده و عملکردش را شبیهسازی کنند. در اصل، اطلاعات بهدستآمده از یک مدل را گرفته و با استفاده از تکنیکی در یادگیری ماشین به نام تقطیر دانش (Knowledge Distillation)، آن را به مدل دیگری منتقل میکنند؛ روشی که برای آموزش مدلهای جدید بر پایه مدلهای پیشرفتهتر به کار میرود.

پژوهشگران GTIG میگویند: استخراج مدل و سپس تقطیر دانش به مهاجم این امکان را میدهد که توسعه مدل هوش مصنوعی را بهسرعت و با هزینهای بهمراتب کمتر پیش ببرد.

در یک حمله گسترده از این نوع، Gemini با ۱۰۰ هزار پرامپت هدف قرار گرفت که مجموعهای از پرسشها را در بر میگرفت و با هدف بازتولید منطق استدلال مدل در طیف وسیعی از وظایف به زبانهای غیرانگلیسی طراحی شده بود.

گوگل این حملات را تهدیدآمیز میداند، زیرا نوعی سرقت مالکیت فکری محسوب میشوند، مقیاسپذیر هستند و بهشدت مدل کسبوکار هوش مصنوعی بهعنوان سرویس (AI-as-a-Service) را تضعیف میکنند؛ موضوعی که میتواند بهزودی بر کاربران نهایی نیز تأثیر بگذارد.

گوگل اعلام کرده است که حسابهای کاربری و زیرساختهای مرتبط با موارد سوءاستفاده شده را مسدود کرده و همچنین، سازوکارهای دفاعی هدفمندی را در سامانههای طبقهبندی Gemini اعمال کرده است تا احتمال سوءاستفاده از این مدل را به حداقل برساند و انجام چنین اقداماتی را دشوارتر و سختتر کند.

0 دیدگاه